我院博士研究生论文被CCF顶会NeurIPS 2024接收

近日,山西大学大数据科学与产业研究院一篇论文被CCF A类会议NeurIPS 2024接收。

论文名称:《Neural Collapse To Multiple Centers For Imbalanced Data》

论文作者:闫泓任,钱宇华(通讯作者),彭甫镕,罗嘉琛,朱哲清,李飞江

论文介绍:神经坍缩(Neural Collapse, NC)描述了神经网络在训练最终阶段(Terminal Phase of Training, TPT)输出特征和分类器权重会在不同的损失函数下收敛到最优的几何结构的特性。然而,这些最优结构在TPT阶段与分类性能之间的关系仍然不够清晰,尤其是在不平衡学习问题当中。有研究发现,固定分类器为最优结构可以缓解小类坍缩问题,但其性能仍然无法与采用可学习分类器的经典不平衡学习方法相媲美。

本文通过设计最优结构来更好地表征分类准则,从而实现分类性能提升。我们证明来自小类的特征应当与更多的方向对齐,这一证明催生了一个称为“广义分类准则”(Generalized Classification Rule, GCR)的决策规则,将这些方向称为类的中心。接着通过均方误差(MSE)类型损失下的无约束特征模型(Unconstrained Features Model, UFM)框架研究塌缩现象,其中:(1)当类别的特征塌缩到该类别对应的多个中心的均值(即多中心神经坍缩,Neural Collapse to Multiple Centers, NCMC)时,UFM获得全局最优;(2) 当NCMC现象发生时,原始分类器近似为GCR的一个替代准则。基于以上理论分析,我们提出了一种确定中心数量的策略,并提出了一种用于固定分类器的余弦损失,该损失在训练中能够诱导NCMC,并且在长尾分类问题上的性能与经典不平衡学习方法相当。

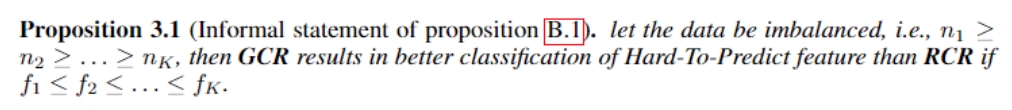

GCR在难预测特征的优越性

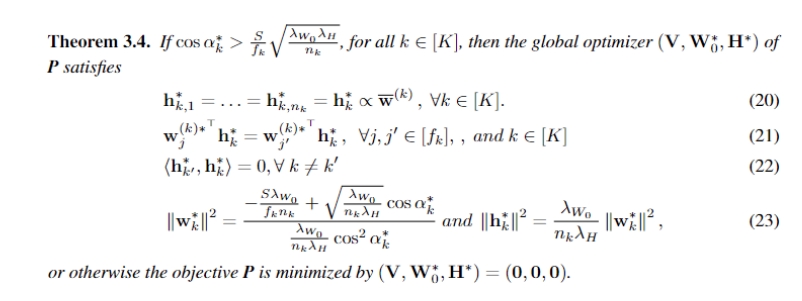

神经塌缩到多中心(NCMC)的UFM全局最优

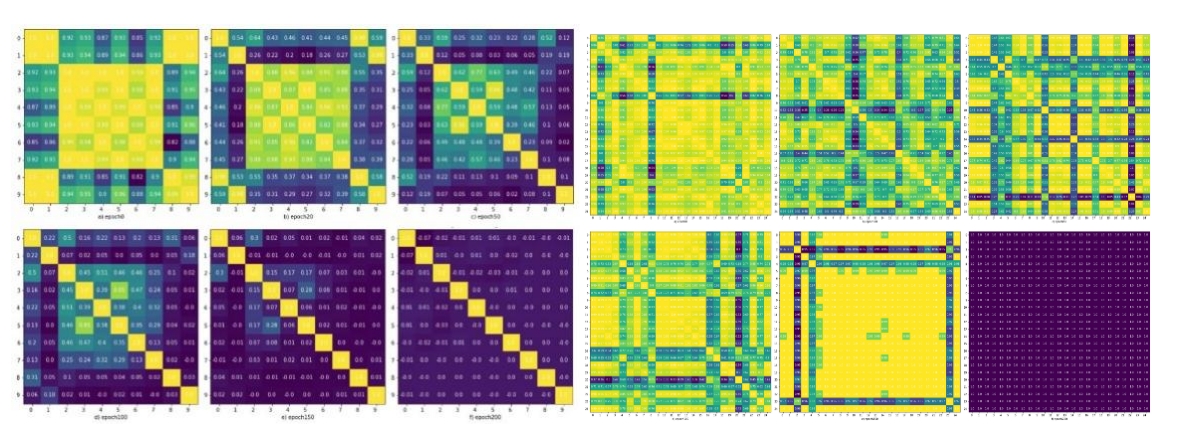

NCMC现象验证:类内特征塌缩,类间特征正交

神经信息处理系统大会(NeurIPS/NIPS)是机器学习和计算神经科学领域的顶尖国际会议(人工智能领域的A类学术会议)。该成果受到自然科学基金重点项目(Nos. 62136005)、国家重大科技专项(No.2021ZD0112400)、自然科学基金项目(Nos.62276162, 62476160, 62306170)、山西省重大科技专项(No. 202201020101006)以及山西省科技创新团队基金(No. 202304051001001)等项目资助。

撰稿人:闫泓任;二审:贾 佳;三审:钱宇华